Андрей ФЕФЕЛОВ, член правления Изборского клуба. Дорогие друзья, сегодня под эгидой Изборского клуба мы открываем серию круглых столов, посвящённых как актуальным социальным вопросам, так и вопросам международной политики. На первом заседании в этом формате с докладом «ИИ в образовании: скрытые угрозы» выступит Андрей Анатольевич Афанасьев, эксперт по информационной безопасности, общественный деятель, автор проекта «На распутье».

Андрей АФАНАСЬЕВ. Я давно занимаюсь изучением деструктивного контента, в основном той его части, которую смотрят дети, и, к сожалению, вынужден констатировать, что губительные технологии, существующие в социальных сетях, постепенно переползают в сферу образования.

Сегодня я хотел бы кратко рассказать о том, как всё это воздействует на детей, начав с механизмов, существующих в социальных сетях. Социальные сети по своей модели заработка устроены таким образом, что деструктивный контент оказывается для них более выгодным, поскольку он считается более «клейким», сильнее привлекающим внимание и дающим больше репостов.

Социальные сети заинтересованы в погружении пользователей в деструктивный контент и проблемные темы, поскольку они заставляют человека проводить больше времени в сети и, соответственно, приносят больший доход компаниям. В сочетании с технологиями искусственного интеллекта это проявляется особенно ярко на платформах коротких видео, таких как «ТикТок» и «Лайк», управляемых алгоритмами.

Механизм их работы таков: ребёнок впервые берёт смартфон с установленным «ТикТоком», не имея ещё сформированных предпочтений, после чего платформа предлагает ему набор случайных роликов, которые он начинает просматривать. По микродвижениям, по способу удержания устройства, по положению пальца на экране, то есть по тем сигналам, которые сам пользователь не фиксирует, система сопоставляет его поведение с миллионами других пользователей и делает вывод о том, какой контент вызывает наибольшую реакцию, после чего начинает усиливать именно его.

Поскольку ролики короткие, за десять минут пользователь может просмотреть до двухсот видео, и по его микрореакциям по истечении этих десяти минут система знает его уже лучше любого психолога, а в отдельных случаях даже лучше родителей. Происходит фактическое «взламывание» психики, и система начинает воздействовать на нервную систему человека, что проявляется в известном эффекте: пользователь заходит в «ТикТок» на несколько минут, но в итоге проводит часы, не замечая этого. От подобных технологий у детей, по сути, отсутствуют механизмы защиты.

Аналогичная ситуация наблюдается и на платформе «Лайк», которую мы тестировали как детский аналог «ТикТока», ориентированный на учащихся младших классов. Тестирование проводилось с разных устройств, находящихся в разных городах, однако пользователям предлагались сходные ролики, среди которых были сцены насилия, шок-контент и издевательства над животными. При этом аккаунты были зарегистрированы как детские, что не помешало платформе систематически подгружать пользователям именно такой контент.

Сходные механизмы действуют и на других платформах, в частности во «ВКонтакте». Например, после моего кратковременного мониторинга всего нескольких суицидальных групп система сделала вывод о моей заинтересованности и начала активно навязывать подобный контент, так что у меня вся лента рекомендаций оказалась насыщена такими материалами. В результате пользователь оказывается замкнут в так называемой эхокамере или семантической капсуле, куда перестаёт проникать иная информация.

Далее алгоритмы начинают управлять эмоциональной реакцией пользователя: определив его позицию, условно говоря, в пользу одной стороны, система подмешивает противоположный контент, стимулируя эмоциональный отклик, увеличение количества комментариев и времени пребывания в сети. Таким образом, алгоритмы социальных сетей ориентированы на провоцирование негативных эмоций, таких как злоба, ненависть и агрессия, поскольку именно такие состояния обеспечивают более длительное удержание пользователя.

И это не теория заговора: существует, например, книга «Десять аргументов удалить все свои аккаунты в социальных сетях» Джарона Ланье, который работал в крупнейших западных компаниях, а затем ушёл из них и написал своего рода исповедь, сформулировав основные принципы работы этих платформ, основанные на погружении человека в деструктивный контент и последующем воздействии на его поведение через негативные эмоции.

Наиболее тревожным является то, что подобная модель начинает использоваться коммерческими образовательными платформами. Недавно меня в качестве родителя пригласили на презентацию платформы «Репетигр» от издательства «Просвещение». Родителей туда заманили, назвав это мероприятие собранием на тему цифровой гигиены. В итоге это оказалось рекламой данной платформы. Её суть заключается в следующем: детям в школах раздают тетради с куар-кодами, содержащие задания разного уровня сложности. Ребёнок наводит камеру телефона на код, после чего открывается приложение-репетитор: на экране появляется виртуальный тигрёнок, который якобы помогает разобраться с задачей, но фактически решает её вместо ребёнка – за полторы тысячи рублей в год.

Издательство «Просвещение», кстати говоря, уже попадало в сферу нашего внимания в связи с выдачей учителям денежных сертификатов на «Озоне». Возникает вопрос: не является ли это коммерческим подкупом?

Ещё есть платформа «Учи.ру» от компании ВК. Там ситуация ещё более сложная: задания делятся на бесплатные и платные, при этом количество бесплатных строго ограничено. Платформа провоцирует постоянную конкуренцию между детьми, формируя рейтинги классов, школ и отдельных учеников, в результате чего дети стремятся повысить своё положение, однако для этого бесплатных заданий оказывается недостаточно, и возникает необходимость приобретения платных.

Естественно, оплачивать эти задания вынуждены родители. Более того, известны случаи, когда учителя ставят неудовлетворительные оценки, если дети не выполняют задания на этой коммерческой платформе. Таким образом, происходит ничем не прикрытая монетизация образовательного процесса, доходящая до внедрения на платформе так называемых лутбоксов — механик, напрямую заимствованных из индустрии азартных игр. Подобные платформы фактически внедряют игровую логику в детское сознание, причём происходит это непосредственно в стенах школы.

Сходные процессы ранее наблюдались с «ТикТоком», хотя на сегодняшний день Министерство просвещения несколько охладело к нему. А ведь ещё три-четыре года назад платформа активно продвигалась, и значительная часть школьной деятельности была связана с созданием и публикацией видеороликов с использованием соответствующих хэштегов.

Позднее акцент сместился в сторону интересов компании ВК, в результате чего появился «Сферум», выполняющий функцию «загона» всех школьников в её основную соцсеть через единый ВК-ID.

Что касается внедрения технологий искусственного интеллекта в образование, следует отметить, что уже существует официальный стандарт, прямо обозначенный как «Искусственный интеллект в образовании», в котором закреплено понятие индивидуальных образовательных траекторий (ИОТ). Эта тема активно продвигается рядом спикеров, которых нередко называют цифросектантами, поскольку транслируемые ими идеи не имеют под собой убедительной научной основы и не демонстрируют очевидных результатов, однако подаются как необходимые.

Суть идеи ИОТ формулируется следующим образом: утверждается, что дети различны по своим способностям и интересам, и потому единый подход к обучению якобы неэффективен. Исходя из этого предлагается заменить учителя системой искусственного интеллекта, которая уже на ранних этапах обучения будет определять дальнейшее направление развития ребёнка: если у него лучше получается математика, значит, ему якобы не нужен русский язык или рисование, и наоборот.

Такая система фактически выстраивает отрицательную обратную связь. Традиционно смысл обучения заключался в преодолении трудностей: если предмет не даётся, ребёнку предлагались дополнительные занятия, и он постепенно осваивал материал. В описываемой модели закрепляется прямо противоположный принцип: если не получается — значит, и не требуется, следует заниматься лишь тем, что даётся легче. Это неизбежно ведёт к упрощению образовательного процесса.

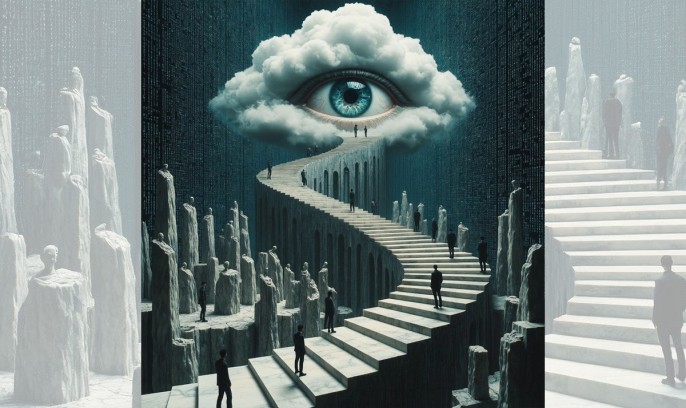

При этом ключевая проблема заключается в том, что искусственный интеллект, происхождение, цели и принципы работы которого остаются неочевидными, получает возможность определять уже не просто образовательную траекторию, а, по сути, судьбу ребёнка — кем он станет. И если такая система ошибётся, остаётся открытым вопрос, кто будет нести ответственность. Подобные механизмы нигде должным образом не регламентированы, однако сама модель «индивидуальных траекторий» активно и повсеместно внедряется.

Причём реализуется это на базе таких платформ, как ГИС «Моя школа» — системообразующего контура, который аккумулирует другие сервисы, включая банк данных по усыновлению и инструменты выявления семейного неблагополучия. Уже на её основе функционирует платформа «Билет в будущее», предлагающая модель ранней профессиональной сегментации. Возникает почти буквальная аналогия с фильмом «Дивергент», где люди распределяются по заранее заданным направлениям — индустриальному, аграрному и другим, — по принципу жёсткой социальной сегрегации. Подчеркну: речь идёт не о гипотезе, а о практике, уже внедряемой в школах. В частности, моего ребёнка зарегистрировали на этой платформе прямо по ходу урока.

Аналогичные принципы прослеживаются и в механизмах так называемого социального рейтинга. Например, на платформе «Мос.ру» электронный дневник фактически функционирует как система ранжирования: каждому ребёнку присваивается числовой показатель, формируемый на основе его успеваемости и сопоставления с другими учениками. Однако принципиально важен не сам расчёт, а способ его предъявления: ребёнок видит не только свой показатель, но и уведомление о его снижении — с указанием на то, что кто-то из одноклассников начал учиться лучше. Тем самым формируется специфическая мотивация, при которой успех другого воспринимается как личное поражение, а образовательный процесс происходит в логике бесконечной конкуренции за место в социальном рейтинге.

К людям, занимающимся цифровизацией, программирующим подобные вещи и внедряющим их в образование, возникают серьёзные вопросы относительно их идеологических и моральных установок.

Что касается «Уроков цифры» и происходящего в их рамках: мне недавно в одном регионе рассказали следующий случай. К руководителю центра, занимающегося дополнительной подготовкой детей, приходит ребёнок одиннадцати лет. Преподаватель объясняет ему материал, а он говорит: «А зачем мне всё это учить? Из меня же сделают цифрового кентавра». Выяснилось, что об этом им рассказывали на «Уроке цифры», сопровождая объяснение слайдами, на которых изображена схема: с одной стороны показан мозг человека, а с другой — искусственный интеллект. Ребёнку на полном серьёзе объясняют, что в будущем его мозг соединят с искусственным интеллектом, а потому учиться ему больше не придётся.

Что касается учителей, то и для них эта система подготовила множество ловушек. Например, существует проект «СберОбразование», в рамках которого учитель пользуется так называемым цифровым помощником, суть которого заключается в следующем: учитель в начале урока включает записывающее устройство, фиксирующее ход занятия, в том числе его речь и взаимодействие с детьми, после чего запись анализируется системой искусственного интеллекта, и по итогам урока учителю выдают оценку того, как он говорил, сколько делал замечаний, сколько хвалил и т. п. Эти данные затем передаются администрации, в частности завучу, и фактически формируется определённый социальный рейтинг. Для учителей это, разумеется, тяжёлая ситуация, поскольку подобные практики в образовании в принципе недопустимы.

При этом те, кто продвигает такие инициативы — а это не только «СберОбразование», но и проект от «Сколково» «Будущее образования», — относятся к родительскому сообществу так, что, мягко говоря, не слышат его и не хотят слышать.

Что касается искусственного интеллекта и его внутренней составляющей, возникает вопрос: кто именно его разрабатывает? На цифровизацию и внедрение искусственного интеллекта выделяются огромные средства, однако, как недавно отмечал ведущий российский ИТ-специалист Игорь Станиславович Ашманов, финансирование направляется преимущественно на внедрение, тогда как на разработку средства фактически не выделяются.

Что это за искусственный интеллект и, самое главное, чей он? Я часто при подготовке презентаций использую генеративные сервисы, в том числе от «Яндекса», а затем обрабатываю изображения в «Фотошопе» для выступлений перед детьми, и мои наблюдения таковы: если задать запрос «нарисуй деньги», система, как правило, выдаёт доллары; если попросить изобразить газировку, это будет кока-кола; если попросить нарисовать ветерана, он выглядит как американский; если солдата — то он будет с винтовкой М16. Таким образом определённая повестка в этих системах изначально заложена. Один из наиболее показательных примеров: я недавно на запрос «Родина-мать, Волгоград, карандашный рисунок» получил изображение статуи Свободы, что свидетельствует о том, что значительная часть доступных нам систем искусственного интеллекта изначально формируется в рамках западной повестки, поверх которой накладываются локальные оболочки в виде сервисов «Яндекса», «Сбера» и других, однако логика принятия решений остаётся внешней.

Особую тревогу вызывает то, что такие технологии уже внедряются в социальную сферу. Появлялись сообщения о случаях, когда семьи лишались пособий, несмотря на наличие всех необходимых документов, поскольку соответствующее решение принималось на основании выводов системы искусственного интеллекта.

Аналогичные процессы затрагивают и стратегические отрасли.

Приведу личный пример: в период сильных морозов у меня отключили электричество, и при обращении в электросети мне ответила система искусственного интеллекта, имитирующая голос оператора, в результате чего мне не удалось получить внятный ответ о сроках восстановления электроснабжения — система замкнула меня в цикле автоматических ответов.

Наконец, следует отметить развитие так называемых ювенальных технологий. Уже сейчас функционируют системы выявления семейного неблагополучия, например в Пермском крае, где с 2018 года действует модель, предполагающая регулярный сбор большого объёма данных о ребёнке — педагоги обязаны раз в две недели вносить более ста показателей, включая сведения о социальном окружении и семейных отношениях. Эти данные собираются в системе и фактически формируют скрытый профиль семьи, причём всё это происходит без информирования родителей. В настоящее время на базе подобных решений запускается федеральный проект информационной системы «Профилактика» («Профилактика детского и семейного неблагополучия»), при этом его разработка ведётся теми же специалистами, которые ранее создавали аналогичную систему в Перми, что указывает на прямую преемственность этой практики.

Очевидно, что в эту систему рано или поздно будет внедрён искусственный интеллект, который будет принимать определённые решения в отношении семьи. Например, в Новосибирске уже появлялась информация о создании некоего цифрового куратора для семьи, однако что это собой представляет, как будет функционировать и на каких основаниях принимать решения, пока остаётся неясным. В условиях, когда отсутствует понимание того, что представляет собой искусственный интеллект, кто его разрабатывает и кому он принадлежит, я считаю необходимым ввести полный мораторий на его использование в социальной сфере, и особенно в образовании.

Василий ШУРОВ, врач-психиатр, нарколог, эксперт по проблематике зависимых состояний. Докладчик хорошо описал ситуацию. Сначала мы фактически отдали интернет-пространство «Ютубу» и прочим иностранным платформам, а затем внезапно выяснилось, что там действуют геополитические противники, которые могут манипулировать людьми как угодно. Теперь мы пытаемся что-то ограничить и заменить, в частности на ВК.

Но в ВК, помимо порнографии, присутствующей в диких количествах, есть и суицидальные группы, что совершенно недопустимо. Платформа извлекает прибыль, не обеспечивая безопасную среду. Это производит крайне удручающее впечатление.

Что касается искусственного интеллекта, то сейчас идёт гонка между США и Китаем. Китай внедряет эти технологии с первого класса школы, развивает инфраструктуру, проводит высокоскоростной интернет в каждую деревню, вследствие чего появляется большое количество виртуальных преподавателей и выстраивается очень жёсткая система отбора детей. Они ставят перед собой задачу подготовки нобелевских лауреатов в каждой области науки и начинают отбор детей с раннего возраста, тестируя их по множеству параметров. Они уже сейчас доминируют на олимпиадах, поскольку при их численности могут отбирать людей с определёнными характеристиками, развивать соответствующие способности и направлять их в нужные области. Это хорошо продуманная система: у них есть редкоземельные и прочие ресурсы, специалисты, собственная школа математиков и программистов.

В то же время Соединённые Штаты вынуждены активно привлекать специалистов из Китая и Индии, поскольку собственную кадровую базу развивают недостаточно.

Как нам, в России, следует использовать ИИ-технологии? Как и атомная энергия, искусственный интеллект может применяться по-разному и при грамотном подходе способен существенно облегчить жизнь в ряде сфер. Однако при бездумном внедрении, когда технологии просто навязываются, например, учителям, возникает закономерное сопротивление. Учителя опасаются этих систем, поскольку уже активно распространяется тезис о том, что они будут заменены. Аналогичная ситуация складывается и в медицинской сфере, где также создаётся ощущение полной замены специалистов ИИ-системами. Между тем речь должна идти не об этом, а о том, что искусственный интеллект является инструментом, которым необходимо пользоваться осмысленно.

Дмитрий АГРАНОВСКИЙ, адвокат. Хотя я и адвокат, но с детства не очень люблю право, потому что право — это что-то типа костылей, на которых заставляют ходить здорового человека. Всё-таки человеческие отношения должны регулироваться прежде всего моралью, нравственностью, а право — это западный инструмент, который «регламентирует» заведомо несовершенного человека. Мне кажется, и проблемы с искусственным интеллектом оттуда же происходят.

С одной стороны, я испытываю огромное восхищение тем, до чего человеческая мысль додумалась при нашей жизни, но, с другой стороны, мы никогда не думали, что будем жить в антиутопии, а вот технически – пожалуйста, она здесь. Мы видим, как выдающиеся достижения человеческой мысли превращаются в инструмент такого тотального контроля, который Оруэллу и не снился. И надо думать над тем, как изменить систему таким образом, чтобы потрясающие достижения человеческой мысли использовались во благо.

А у нас это всё используется в совершенно прикладных целях зарабатывания денег и контроля. А ведь эти инструменты предназначены для решения глобальных задач. Если бы, например, Сталину и его наркомам такие инструменты? Как бы они ими распорядились?

Андрей АФАНАСЬЕВ. Я думаю, первое, что они бы сделали, — вызвали разработчиков и потребовали от них описания алгоритмов. То есть как это работает. А особенность искусственного интеллекта в том, что он принимает некое решение по человеку, по его судьбе, а понять, почему он его принял, невозможно. И даже те, кто придумал ИИ, не могут ответить на этот вопрос. То есть это волшебная коробочка, которая принимает решение исходя из каких-то своих соображений. Рисовать с её помощью презентации можно, а в социальной сфере использовать нельзя. Всегда должно быть ответственное лицо.

А сейчас некоторые чиновники используют искусственный интеллект как средство передачи ответственности. Люди спрашивают: «Вы что наделали, почему меня лишили пособия?» А им в ответ: «А мы ничего не можем сделать, искусственный интеллект так решил».

Когда мой сайт попал в чёрный список «Яндекса» (это произошло после того, как я в Общественной палате сказал, что «Яндекс» выдаёт порнографию без возрастной верификации и на этом зарабатывает), я направил «Яндексу» запрос: «На каком основании мой сайт пропал из выдачи поисковика?» Отвечают: «Решение по вам принял искусственный интеллект». Я говорю: «Ну хорошо, объясните причины». «Мы не можем объяснить, мы в это не вмешиваемся, у нас искусственный интеллект». Всё.

Алексей ПЛОТНИКОВ, доктор исторических наук, профессор Московского государственного лингвистического университета. Социальную сферу, очевидно, нельзя передавать в ведение искусственного интеллекта, однако возникает вопрос: какова правовая основа подобных решений и содержатся ли в Конституции или федеральных законах положения, прямо допускающие использование искусственного интеллекта в социальной сфере? Я о таких нормах не слышал.

Я не являюсь специалистом в сфере школьного образования, однако мне известно, что там происходят тревожные процессы: знакомые, работающие в системе, поначалу испытывают резкое неприятие нововведений, но со временем вынуждены к ним привыкать.

Каким образом возможно внедрение ювенальных практик на основе искусственного интеллекта и допустимо ли решать вопросы лишения родительских прав подобным образом? Очевидно, что решение должен принимать человек с обязательным выслушиванием сторон, как это предусмотрено судебной процедурой. Судья обязан учитывать доводы сторон, в том числе и с позиции человеческой морали.

Данная проблема должна быть вынесена на уровень Государственной Думы и Правительства с требованием выработки необходимых законов и решений.

Наше общество традиционно ориентировано на идею справедливости и защиту человеческого достоинства, поэтому внедрение искусственного интеллекта в социальную сферу воспринимается как несправедливость.

Андрей АФАНАСЬЕВ. Могу пояснить, каким образом это реализуется на практике. Несколько лет назад был принят закон об экспериментальных правовых режимах. Суть его заключается в следующем: при наличии действующей правовой системы и Конституции после принятия данного закона правительство получает возможность объявлять в отдельных регионах, например, в Новгородской или Московской области, о введении экспериментального правового режима. Происходит частичное нивелирование действующих норм, разумеется, не затрагивающее уголовное законодательство, но связанное, например, с внедрением технологий искусственного интеллекта и сбором персональных данных.

Объявляется, что тот или иной регион включён в режим цифровой образовательной среды, и это трактуется как эксперимент, хотя по своей природе участие в эксперименте предполагает добровольное согласие участников. В действительности же формируется своего рода презумпция согласия, при которой фактического волеизъявления со стороны граждан не требуется. Именно в этом заключается основная проблема, поскольку подобный механизм был заложен в момент принятия закона об экспериментальных правовых режимах.

Мария ДУБИНСКАЯ, обозреватель канала «День», общественный деятель. Слова Андрея Анатольевича я готова подтвердить не только как журналист, но и как мама. В школе, где учится мой ребёнок, ребятам тоже активно навязывают различные образовательные платформы, в том числе «Учи.ру». Будучи вовлечённой в жизнь родительского сообщества, знаю, какие вопросы тревожат думающих родителей. В связи с развитием ИИ очевиден один ключевой вопрос: как защитить наших детей от попыток формализованного, роботизированного воздействия на их сознание, от навязывания им определённых поведенческих моделей? Очевидно, что происходит процесс расчеловечивания, который начинается уже с детского сада и начальной школы.

Второй вызывающий серьёзную тревогу момент заключается в том, что дети всё больше отдаляются от реальной жизни. Если поставить ребёнка перед выбором между книгой, живым общением с ровесниками — и искусственным интеллектом, то, будем честны, многие выберут последнее. Таким образом, мы фактически уводим детей в виртуальную, иллюзорную реальность, отдаляя от опыта жизни. Это вызывает у родителей серьёзное беспокойство.

Андрей АФАНАСЬЕВ. В первую очередь необходимо объяснять всё это другим родителям, поскольку большинство из них просто не задумываются о происходящем, у них просто нет времени в этом разбираться. Но каждому родителю необходимо сознательно искать это время, отказываясь от привычных занятий, будь то просмотр сериалов или маркетплейсов. Вместо этого пытаться понять, почему ребёнок оказывается зависимым, что именно делает с ним цифровая среда, как работают платформы, почему ребёнок безостановочно играет и тратит деньги на «донаты».

Рассказывая об этом на встречах с родителями, детьми и учителями, я вижу, что сама тема вызывает живой интерес, однако им не хватает доступной и системно изложенной информации по данному вопросу. Современная медиасреда устроена таким образом, что подобная проблематика практически не продвигается алгоритмами: если бы речь шла о пользе индивидуальных образовательных траекторий или социальных сетей, такие материалы набирали бы сотни тысяч просмотров, тогда как критическая информация не получает распространения. При этом социальные сети и поисковики утверждают, что ответственности за это не несут, ссылаясь на предпочтения аудитории. В этой связи всё чаще высказывается предложение законодательно обязать социальные сети раскрывать принципы работы алгоритмов, чтобы пользователи понимали, по каким причинам они получают ту или иную информацию.

Необходимо разъяснять происходящее не только родителям, но и учителям, которые, оказываясь заложниками сложившейся системы, зачастую не поддерживают это, однако вынуждены следовать навязываемым требованиям, не всегда ясно понимая, что из этого действительно является обязательным. Возьмём, к примеру, ситуацию со «Сферумом». На протяжении длительного времени его использование фактически преподносилось как обязательное, тогда как регистрация на любой платформе представляет собой форму соглашения, предполагающую права и обязанности сторон, а принуждение к такому соглашению противоречит базовым правовым нормам.

Поэтому важно разъяснять эти вещи спокойно и последовательно, без конфронтации. Я всегда призываю родителей не вступать в конфликты с учителями или администрацией, но объяснять, почему они не хотят, чтобы ребёнок использовал те или иные платформы, какие риски с этим связаны и как это влияет на его развитие. Только в этом случае можно рассчитывать на изменения.

Руслан САФАРОВ, политолог, эксперт Финансового университета при Правительстве РФ. Я преподаю и сталкиваюсь с этой проблемой буквально ежедневно. Недавно общался со своим коллегой из Тегеранского университета (он приезжал в Москву), и он рассказал, что давно отказался от письменных работ и перешёл исключительно к живому общению со студентами.

Существуют программы, позволяющие выявлять тексты, созданные с помощью искусственного интеллекта, однако студенты всё равно пытаются им пользоваться. Ситуация здесь двойственная. С одной стороны, мы имеем дело с новым поколением, и в своё время аналогичные претензии предъявлялись и нашему поколению, которое выросло на компьютерных играх. Тогда тоже говорили, что мы только играем и ничего из себя не представляем, и, хотя доля истины в этом была, среди нас выросли и вполне состоявшиеся люди. С другой стороны, нынешние студенты живут в цифровой среде, и здесь многое зависит от того, как выстроен образовательный процесс. При грамотной постановке задачи можно использовать элементы инфотейнмента, чтобы повысить вовлечённость, но главное — по-настоящему вкладываться в студентов. Они, будучи живыми людьми, откликаются, и интерес к предмету можно пробудить.

И здесь мы выходим на вторую важную проблему, о которой уже шла речь, — положение учителя и преподавателя. Они вынуждены брать две-три ставки, и в этих условиях говорить о полноценной отдаче крайне сложно. Необходимо улучшать условия жизни преподавателей, повышать заработную плату, чтобы им не нужно было брать больше одной ставки, ведь перегруженный и уставший человек в какой-то момент неизбежно отстраняется от процесса и начинает перекладывать часть своих функций на пиксельного репетигрёнка.

А искусственный интеллект можно направить туда, где он действительно способен приносить пользу, освобождая человеческие ресурсы.

Андрей АФАНАСЬЕВ. Продолжая разговор об искусственном интеллекте, приведу ещё один пример, о котором почему-то редко упоминают: искусственный интеллект не оперирует такими категориями, как правда, ложь, справедливость и тому подобное.

Приведу конкретный случай. Когда я дописывал вторую часть книги, у меня была большая глава, посвящённая компьютерным играм, и мне потребовались цитаты разработчиков из западных компаний, в которых они прямо говорили бы о том, что игровые механики, включая лутбоксы, направлены на извлечение прибыли. Я сформулировал соответствующий запрос в «Дипсик» и попросил привести такие цитаты.

В ответ была выдана подборка примерно из десяти высказываний, приписанных руководителям крупных компаний, включая «Близзард» и «Активижн». При этом формулировки были настолько точно подогнаны под мой запрос, что это вызвало у меня сомнения. В частности, среди них встречались утверждения вроде: «Мы создаём лутбоксы, чтобы формировать зависимость, это наш бизнес».

Далее, среди этих цитат я обнаружил высказывание, приписанное Дмитрию Смиту, директору Федерации компьютерного спорта России, в котором утверждалось, что большинство геймеров в будущем будут зарабатывать меньше дворника. Поскольку я знаком с его позицией и знаю, что он является сторонником развития киберспорта, стало очевидно, что подобная фраза не могла принадлежать ему. После этого я решил проверить все приведённые источники и запросил ссылки. Система их предоставила, однако при переходе по ним оказалось, что страницы либо не существуют, либо не содержат указанных высказываний. Стало ясно, что цитаты являются вымышленными.

На мой прямой вопрос о достоверности этих цитат система начала давать уклончивые ответы, сводящиеся к тому, что подобные высказывания якобы могли быть сделаны, хотя точных подтверждений нет. И это, по сути, демонстрирует принцип её работы. Искусственный интеллект в значительной степени ориентирован на стремление соответствовать ожиданиям пользователя. Именно поэтому в ряде стран уже возникают судебные иски, в том числе связанные с ситуациями, когда пользователи, находясь в тяжёлом психологическом состоянии, получали от системы ответы, не только не препятствующие деструктивным действиям, но фактически их поддерживающие.

Таким образом, если система изначально ориентирована на согласие с пользователем, она будет усиливать любые девиации и заданные пользователем установки, включая потенциально деструктивные. И в этом заключается одна из фундаментальных проблем текущих моделей искусственного интеллекта.

Елена ЯНЧУК, журналист, общественный деятель. Мне кажется, уместно вспомнить советский опыт, причём я имею в виду не столько советский опыт разработки искусственного интеллекта, хотя в СССР этим довольно активно занимались, сколько сами принципы, заложенные в основу советского образования. Речь идёт, в частности, о сильной естественно-научной подготовке. До сих пор в таких областях, как математика, физика, программирование, информатика, мы остаёмся весьма конкурентоспособными на мировом уровне.

Это необходимо сохранять и не заявлять, что нужно всё запретить, поскольку в этом случае мы рискуем подготовить детей к миру, которого уже не существует. Но важно не заниматься коммерческими внедрениями, поскольку перечисленные коллегами вещи действительно чудовищны. В случае навязывания разнообразных платных услуг вполне можно обращаться в прокуратуру, и, если последовательно разбирать подобные случаи на уровне органов власти, правоохранительной системы, при участии депутатского корпуса, ситуацию можно исправить.

Уже приводился пример Китая, где технологии ИИ внедряются с детского сада, однако при этом детям объясняют, что такое искусственный интеллект, формируют критическое отношение к нему, и он используется только как индивидуальный помощник, а не как гуру.

Согласна с тем, что ранняя профилизация является крайне вредной, поскольку школа должна прежде всего обеспечивать базовое образование. Вместе с тем если говорить о частных трудностях ученика, то ИИ в качестве индивидуального помощника, способного выявлять и восполнять отдельные пробелы, будь то геометрия, русский язык или другие предметы, в которых у ученика возникают трудности, может быть полезен.

Андрей АФАНАСЬЕВ. Вы сказали, что искусственный интеллект может помочь учиться, разобраться, однако, если посмотреть на практику его использования, картина оказывается иной. Вся реклама таких технологий, будь то платформы «Сбера», «Яндекса» или МТС, строится на тезисе, что искусственный интеллект «поможет понять тему», но в действительности он, как правило, не помогает разобраться, а помогает получить готовое решение.

По сути, его используют для того, чтобы ввести вопрос и сразу получить ответ, не проходя через процесс понимания, и если в таком виде его допускают в образовательную среду, то это приводит к уже наблюдаемым последствиям. Раньше дети пользовались готовыми домашними заданиями, скачивали их с соответствующих сайтов, теперь они обращаются к генеративным моделям, которые решают за них задачи. Подобные ситуации уже описаны в западной литературе: ученик, получив домашнее задание в электронном виде, не вникая в его содержание, копирует его в систему, получает ответ и так же, не проверяя, пересылает его учителю, который, в свою очередь, может отнестись к этому столь же формально. В результате сам образовательный процесс подменяется механическим обменом готовыми решениями, лишёнными понимания.

Елена ЯНЧУК. Как уже было сказано коллегами, многие преподаватели к этому приспособились и просто перестают давать задания в прежнем виде, понимая, что их можно выполнить формально. Очевидно, что подход необходимо менять: если задание выполнено с помощью искусственного интеллекта, то дальше следует проверка понимания, например у доски, где ученик должен доказать решение и пройти весь ход рассуждения самостоятельно, и в таком случае формальное использование сразу становится бессмысленным.

Вместе с тем утверждение о том, что никто не использует эти технологии для понимания, всё же не вполне точно. На мой взгляд, здесь принципиально важно объяснять детям, как это работает, формируя у них критическое мышление. Полностью закрываться от ИИ невозможно, он действительно способен приносить пользу, при этом надо помнить, что он зависим от инфраструктуры, будь то электричество или доступ к сети.

Андрей ФЕФЕЛОВ. Перефразируя: возможен ли искусственный интеллект с человеческим лицом?

Андрей АФАНАСЬЕВ. «Искусственный интеллект здорового человека»? Проблема, на мой взгляд, заключается в том, что эта самая «волшебная коробочка» становится для ребёнка основным способом восприятия мира. Есть исследования, в частности компании «Медиаскоп»: если раньше статистика начиналась с шести лет и показывала, что в этом возрасте около 50–60% детей регулярно находятся в интернете, то в более поздних исследованиях порог был снижен до четырёх лет, и там уже речь идёт о 80–90% детей, причём многие пользуются устройствами без контроля родителей.

Таким образом, с самого раннего возраста их картина мира формируется через экран, а это мир постоянных стимулов, уведомлений, игр, яркого и привлекательного контента. На этом фоне обучение начинает восприниматься как обязанность, от которой нужно как можно быстрее избавиться: приходит задание, его стремятся формально выполнить, например, отправив в генеративную систему и получив готовый ответ, после чего внимание снова переключается на развлекательную среду.

Это та реальность, с которой мы сейчас сталкиваемся, и если образовательная система начнёт дополнительно подкреплять подобную модель поведения, предлагая «научиться пользоваться» искусственным интеллектом, то ситуация лишь усугубится. Освоение таких инструментов не требует значительных усилий — они вполне сопоставимы с поисковыми системами или социальными сетями, и базовые навыки их использования приобретаются за короткое время. Проблема заключается не в умении пользоваться, а в том, что при таком подходе исчезает сама необходимость в усилии, в понимании и преодолении трудностей, которые и составляют основу образовательного процесса.

Елена ЯНЧУК. Речь идёт не о том, чтобы учить детей писать промпты, хотя такая профессия, как промпт-инженер, уже существует, и игнорировать этот факт невозможно. Мне представляется более важным объяснять, как устроены эти системы, чем отличаются различные модели и на каких принципах они работают. В более продвинутых классах, например математических, можно было бы предложить учащимся попробовать создать простую модель, чтобы они понимали внутреннюю логику этих процессов.

Андрей АФАНАСЬЕВ. Это, скорее, уровень профильных кафедр, где этим специально занимаются.

Андрей ФЕФЕЛОВ. Предлагаю подвести итоги и каждому кратко сформулировать своё резюме. Прошу обозначить и некую позитивную программу, ответив на вопрос о том, что необходимо делать и как действовать в этой ситуации, которая представляет собой не только вызов в сфере образования, но и вызов цивилизационный. Возможно, существуют как общие соображения, так и конкретные рекомендации для власти, родителей и общества в целом.

Василий ШУРОВ. Многие слышали утверждение о том, что четырёхлетний ребёнок уже полностью сформирован. Это утверждение не выдерживает критики, и им хотят прикрыть тот факт, что в этом возрасте он формируется так называемой экономикой внимания и теми структурами, которые воздействуют на него в собственных интересах, навязывая внешние модели поведения. Это недопустимо. Ребёнок должен развиваться естественно, двигаясь, рисуя, читая, и в этой связи возникает вопрос, какое место здесь вообще может занимать искусственный интеллект. Возможно, по мере созревания мозга допустимо ограниченное использование ИИ, однако речь точно не может идти о детском саде и начальной школе.

При этом сама идея выявления слабых сторон ученика заслуживает внимания, особенно если учитывать перегруженность педагогов, вынужденных заниматься отчётностью, проверкой тетрадей и другими формальными обязанностями и приходящих в итоге к состоянию профессионального выгорания. В этом смысле искусственный интеллект мог бы рассматриваться как вспомогательный инструмент для учителя, не выступая при этом навязываемой извне коммерческой системой, которая уже во многом подменяет образовательный процесс и приводит к тому, что родители вынуждены тратить средства, не имея ясного представления о результате. Особенно тревожной представляется ситуация в социальной сфере, где предпринимаются попытки передавать искусственному интеллекту функции оценки родительской состоятельности, притом что сама система ювенальной юстиции нередко действует противоречиво, в одних случаях игнорируя очевидные проблемы, а в других приводя к чрезмерно жёстким решениям, включая изъятие детей, и логика подобных действий зачастую остаётся неясной.

В этих условиях защита ребёнка должна оставаться безусловным приоритетом, а внедрение технологий возможно лишь по мере его психологической и возрастной готовности.

Кроме того, вопросы вызывает зависимость от зарубежных технологических решений, будь то американские или китайские разработки.

И вспомним ещё эпизод, когда Герман Греф с энтузиазмом представлял искусственный интеллект нашему президенту, а Владимир Путин в ответ иронично заметил, что в таком случае, возможно, следует задуматься о замене им самого главы «Сбера». На что тот ответил: «Надеюсь, не при моей жизни». И эта реплика показывает, что даже на уровне инициаторов внедрения ИИ не до конца осмыслены последствия продвигаемых технологий.

Дмитрий АГРАНОВСКИЙ. Я вспомнил девяностые годы, когда убивали наше самолётостроение, вполне, как теперь выясняется, конкурентоспособное. Претензии, предъявлявшиеся к нему, выглядели откровенно смехотворно: речь шла, например, о большом расходе топлива или о каких-то иных второстепенных параметрах, которые для государства в целом не имели принципиального значения. Один чиновник из руководства «Аэрофлота» на замечание о том, что у нас есть собственные самолёты, ответил: «Нам некогда исправлять чужие недостатки», — после чего начались закупки «Боингов».

Я, кстати, ещё до поступления в МГУ учился в техникуме по специальности «Ремонт и эксплуатация вычислительных машин» и могу сказать, что в восьмидесятые годы наше отставание в электронике было минимальным. Нам ставили в вину то, что мы копировали передовые микросхемы, однако это вовсе не означало механического заимствования, поскольку для этого требовались собственные технологические решения и серьёзная инженерная база. Сегодня же в этой сфере практически всё является иностранным.

При этом искусственный интеллект сам по себе является выдающимся достижением, действительно масштабным изобретением, однако решающим остаётся вопрос о том, в чьих руках он находится. На сегодняшний день он во многом сосредоточен в руках у людей, не обладающих стратегическим мышлением и ориентированных прежде всего на извлечение прибыли, и в этих условиях речь идёт не о развитии, а о краткосрочной выгоде.

Именно поэтому необходимы изменения на уровне принципов управления: такие сферы, как образование, должны находиться под жёстким государственным регулированием и контролем, поскольку речь идёт о будущем общества. Через некоторое время именно сегодняшние дети будут определять облик страны, и, если процессы их формирования окажутся полностью отданы на откуп неконтролируемым технологиям, последствия могут быть крайне серьёзными. При этом важно, чтобы само государство ориентировалось не на извлечение прибыли, а на развитие, ставя перед собой долгосрочные цели, подобно тому, как это происходило, например, в советской модели или в современной китайской практике.

Алексей ПЛОТНИКОВ. Мы все понимаем, что ситуация далека от идеальной, однако решения принимают разумные люди, в том числе на уровне Правительства, и они не заинтересованы в подрыве собственного будущего, поскольку при бесконтрольном развитии подобных технологий мы действительно рискуем остаться в прямом смысле без будущего поколения. При этом я не склонен к крайним оценкам, поскольку мой опыт общения со студентами показывает, что традиционные, проверенные временем методики сохраняют свою эффективность. Я всегда разрешаю студентам пользоваться интернетом, но одновременно с этим необходимо применять практические способы проверки знаний: если письменные работы вызывают сомнения, следует требовать от студента указания источников, умения цитировать и аргументированно отвечать у доски, где сразу становится очевидным уровень понимания материала. Поскольку в конечном счёте студенты стремятся к развитию, надо создать для этого необходимые условия.

Что касается внедрения ИИ, то требуется искать разумный баланс, обеспечивая, с одной стороны, жёсткое участие государства и контроль, а с другой — вовлечение родительского сообщества и общественных организаций, которые могли бы активно участвовать в обсуждении и регулировании этих процессов, в том числе через такие институты, как Общественная палата и публичные слушания.

Мария ДУБИНСКАЯ. Я, безусловно, поддерживаю необходимость контроля и считаю обязательным создание некой рабочей группы, комиссии, которая будет анализировать риски и последствия внедрения ИИ в образование, и шире — в социальную сферу. Только после всестороннего анализа можно разрешать внедрение определённых форм ИИ, например, проводить факультативы по искусственному интеллекту для старшеклассников. Но в целом подрастающему поколению прежде всего необходимы реальная жизнь, реальная дружба, реальные чувства, живое общение друг с другом, книги. Технологии — по мере взросления, очень дозированно и под контролем взрослых.

Андрей ФЕФЕЛОВ. Я думаю, что подобная комиссия должна быть при Академии наук, сообществе учёных, которые собирают данные и несут ответственность за свои выводы, и, возможно, именно в рамках таких регламентированных общественных и государственных структур следует проводить научные эксперименты, в том числе и в социальной сфере.

Руслан САФАРОВ. Представляется необходимым сделать обучение более продуманным, не доводя его до той перегруженности, которую мне недавно довелось наблюдать в одном учебнике по математике, где материал оформлен столь хаотично, что ребёнок не может сосредоточиться. Можно использовать сталинские учебники, благодаря которым учащиеся начинают понимать принципы русского языка и других дисциплин.

Если говорить о возможных ограничениях, то стоит реально ограничить использование смартфонов в школе, разрешив использование только обычных телефонов, не обладающих отвлекающим функционалом.

Сегодня разворачивается серьёзная международная конкуренция в сфере искусственного интеллекта, и, пока этот процесс не завершён, все участники стремятся занять в нём своё место. Однако проблема заключается в необходимости выработки международных договорённостей, поскольку речь идёт не только о риске формирования поколения с ослабленными когнитивными навыками, которое со временем придёт на смену нам в профессии, но и о том, что искусственный интеллект уже становится участником военных действий, что, в частности, наблюдается на Ближнем Востоке. В этой связи представляется необходимым проведение международной конференции или иного формата соглашения, в рамках которого могли бы быть выработаны базовые решения, подобно тому, как это происходило в своё время в отношении клонирования.

Искусственный интеллект может быть полезен в ряде сфер, таких как промышленность, выполнение сложных расчётов, обработка больших массивов данных, космическая отрасль, где требуется рассчитывать траектории полёта, тогда как в гуманитарной и образовательной областях, на мой взгляд, необходимы жёсткие ограничения.

Елена ЯНЧУК. Есть ещё проблема, о которой стоит сказать отдельно. Речь идёт о риске формирования тенденции, при которой будет продвигаться идея максимального перевода обучения в дистанционный формат с опорой на искусственный интеллект, тогда как очное образование сохранится лишь для узкого круга. Подобные тезисы уже периодически появляются, и важно постоянно доносить до государства, что традиционное очное образование с участием учителя является принципиально значимым. Об этом говорят и специалисты в области образования, и детские психологи, это подтвердил и опыт дистанционного обучения в период ковида, когда существенно снизилось качество образования и уровень внимания у детей. Таким образом, необходимо не только повышать престиж традиционного образования, но и закреплять на уровне государственной политики понимание того, что, при всей значимости технологий, отказываться от очного обучения недопустимо.

Искусственный интеллект следует рассматривать как инструмент, который может оказывать как негативное, так и позитивное влияние, в том числе на формирование личности ребёнка и его когнитивные процессы. Поэтому к его использованию должны подключаться специалисты разных областей, включая психологов и педагогов. Вместе с тем это инструмент, который при грамотном применении способен улучшать и оптимизировать ряд процессов, в частности помогать учителю. Соответственно, в рамках национальной концепции необходимо обсуждать с участием специалистов в области искусственного интеллекта, а также представителей смежных дисциплин, включая психологов, политиков, общественных деятелей и родителей, этические принципы его использования, допустимые сферы применения и базовые ограничения.

Кроме того, важно включать в образовательный процесс объяснение того, что представляет собой искусственный интеллект, например на уроках информатики, предлагая детям создавать простые модели, чтобы для них это не оставалось «чёрным ящиком» и не воспринималось как универсальный инструмент, подменяющий собственное мышление.

Андрей ФЕФЕЛОВ. Все затронутые темы крайне актуальны, поскольку здесь сходятся две ключевые проблемы: первая — проблема так называемого искусственного интеллекта, который, по сути, представляет собой скорее его имитацию, и вторая, не менее значимая, — проблема образования. Вопрос государственного регулирования в этих сферах представляется исключительно важным.

Мне кажется перспективной идея создания Соборной социальной сети России, о чём я писал в нескольких статьях. Она позволяет решить две принципиальные задачи. Во-первых, создать модель, ориентированную на движение к определённому общественному идеалу, который, впрочем, ещё предстоит ясно сформулировать. Во-вторых, на базе такой системы можно запустить механизмы развития, действующие под надзором не только правовым, но и научно-интеллектуальным, чтобы проводимые эксперименты осуществлялись в русле движения к этому идеалу. Иными словами, необходимо определить направление и способы решения этой сверхзадачи. В рамках нашей беседы обсуждение общественного идеала не предусмотрено, однако, на мой взгляд, этот вопрос является ключевым. Неслучайно наука об общественном идеале называется идеологией.

Комментарий Изборского клуба

Судьбу человека не должна определять безымянная программа — так называемый «чёрный ящик». Лишат ли семью пособия, куда пойдёт учиться ребёнок — нужен закон, который запретит использовать ИИ в таких важных вопросах без участия живого ответственного лица. Чиновник должен ставить свою подпись и отвечать за решение лично.

При Российской академии наук необходимо создать совет из педагогов, психологов и экспертов в области ИИ, который будет проверять любые новинки и программы перед тем, как запустить их в школы. Важно, чтобы решения принимались не в угоду бизнесу, а ради пользы детей.

Если издательство поощряет учителя за то, что он загоняет детей на платный сайт, — это взятка и коррупция. Такие схемы должны пресекаться правоохранителями. Никто не имеет права заставлять родителей покупать подписки или регистрировать детей на коммерческих платформах. Принуждение к сделке незаконно.

Раз уж дети научились списывать с помощью нейросетей, учителям пора менять подход: меньше письменных домашних заданий — больше устных ответов, защиты проектов.

Технологии искусственного интеллекта и цифровые платформы представляют собой мощнейший инструмент развития, но в воспитании нельзя слепо доверять машинам. Живое общение, реальный мир, тёплые отношения между людьми — вот что должно быть в основе. Никакой анонимный алгоритм, созданный неизвестно кем и где, не имеет права решать, каким вырастет человек будущего.